在经过一年的沉淀后,硅谷具身智能创企 Genesis AI 终于在今天带来了其首个机器人基础模型系统 GENE-26.5,在这套系统下,机器人能够自己复原魔方,还可以打鸡蛋、切番茄,展示出了不同以往的灵巧操作能力。

相较于以往许多厂商发布时侧重于展示单点模型能力,这次 Genesis AI 最值得关注的,是把「机器人操作」当成了一套完整系统工程来做。

在过去几年,行业里很多团队更偏向模型中心路线。也就是模型越大、数据越多、泛化越强,机器人自然会变聪明。

但 Genesis AI 的判断是,仅靠模型,不足以解决灵巧操作。他们认为,真正决定上限的,是整个全栈系统。

所以这次发布的 GENE-26.5,本质上是一整套体系,包含基础模型、仿真系统、灵巧手、数据采集手套、控制中间件、实时控制系统、多模态训练框架等方面,都加入了自身的全栈理解。

作为一家成立于 2024 年底的机器人公司,在去年 7 月, Genesis AI 还拿到了 1.05 亿美元的融资,创下了硅谷当时具身赛道最大种子轮融资纪录。

在这将近一年的时间里,GENE-26.5 这项最新成果,开始让行业重新审视一个问题:机器人距离「人类级操作能力」,是不是比想象中更近?

GENE-26.5 的灵巧操作有何不同?

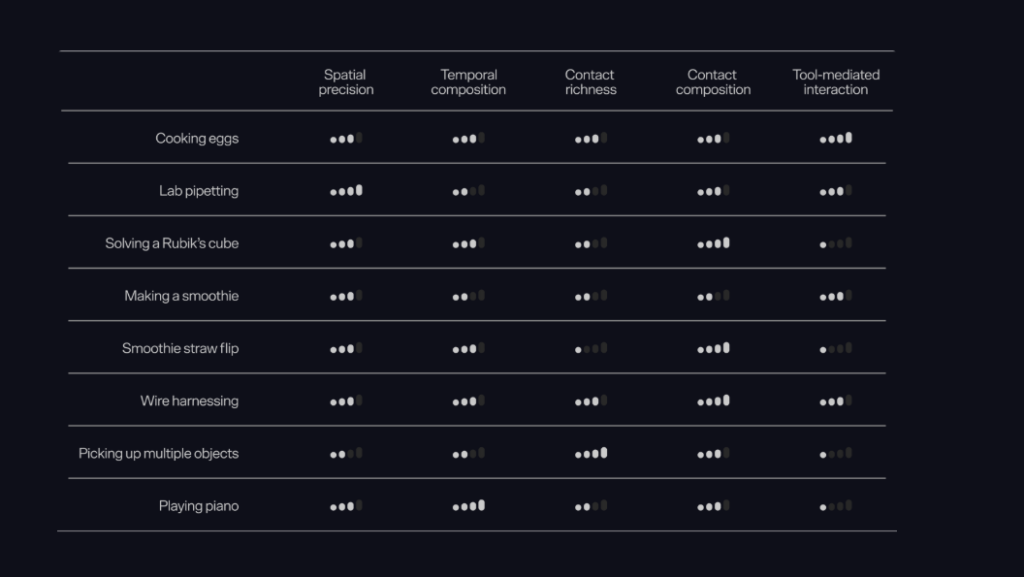

提到想让机器人在家里做点什么,很多人第一时间想到的就是做饭,但这对机器人来说并不容易,在复杂的长程任务中,机器人需要完成数十个子任务,非常考验协调和规划能力。

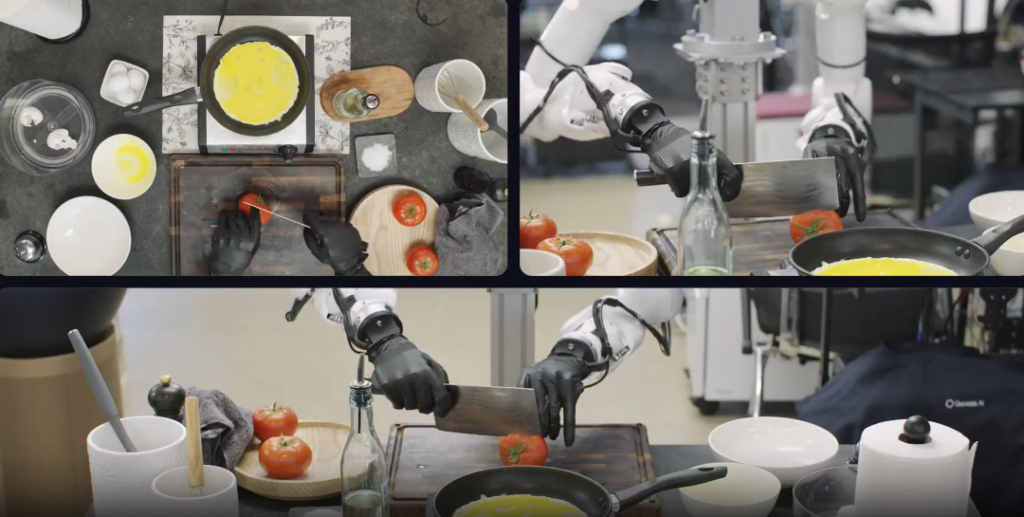

这次 GENE-26.5 带来的核心成果之一,就是做饭。在大概 4 分钟的长程任务中,机器人所展示的做饭逻辑,很多情况下和人类非常相近。

在用单手将鸡蛋磕开之后,机器人顺便用手边的毛巾擦了擦手,以免蛋液弄脏其他食材。

在切番茄时,机器人会一手辅助按住番茄,一手拿刀切,将多余番茄根扔掉后,机器人从中间切了第一刀,随后调转方向,把番茄切块,随后它再把这些番茄块抹到刀上,倒在锅里。

机器人这套干活的逻辑,非常像经常下厨的人类,而且整个画面并没有加速,在 1 倍速下,可以看出机器人的干活速度已经没有了缓慢笨拙感。

在双手协同这方面,GENE-26.5 还展示了一个双手复原魔方的技能。

不同于 2019 年 OpenAI 的单手复原,GENE-26.5 的重点是用通用模型来处理问题,并非专用策略。

并且双手的协同操作,对于灵巧手操控的灵敏和精确程度要求极高,所以很多厂商在推出新款灵巧手时,都喜欢用复原魔方来展示产品能力。

在实验室移液这项现阶段有商业化应用潜力的任务中,机器人可以完成抓取移液枪、插枪头、转移、密封等一系列精细操作流程,而且也很考验其使用精细工具的能力。

这项枯燥且重复性强的任务如果标准化做好,就是灵巧机器人从 Demo 走向产业化应用的最佳切入点之一。

另外,在工业场景中的线束整理任务中,机器人可以用自己的灵巧手优势,一手辅助,一手环绕,用胶带将线束整理完毕。

值得一提的是,团队还让机器人弹奏了 Rush E 钢琴曲,通过看曲谱,机器人必须精准的将手指放在对应键位上,并且速度不能慢。

从依旧 1 倍速的视频速度看,Genesis 对自家机器人的能力,相当自信。

值得一提的是,很多演示中的任务,团队只用了不到 1 小时的特定机器人数据,甚至 20 秒内的技能,只用不到 200 段轨迹就可以做到。

而这些,则依赖于 Genesis 的全栈能力,也是整个 GENE-26.5 最重要的部分。

核心从来都不只是模型

Genesis 核心观点之一是这样的:机器人操控是系统问题,不是纯 AI 问题。

这与当前行业许多「模型中心」的思路有所不同。

团队认为,传感器、执行器、控制、数据和模型这五层中,任何一层的短板都会拖累整体表现。更重要的是,很多看似需要模型解决的问题,其实可以在其他层更根本地解决。

所以在全栈层面,Genesis 遵循下面这五个基础:

- 弥合形态差距,硬件层面直接对齐人类手部,而非在模型中补偿。

- 高保真现场数据,数据采集融入真实工作流,而非破坏它。

- 低延迟控制,消除控制意图与实际执行之间的偏差。

- 原生机器人模型,支持语言、视觉、本体、触觉、动作的联合建模。

- 规模化评估,模拟 + 真实世界双轨,使快速迭代成为可能。

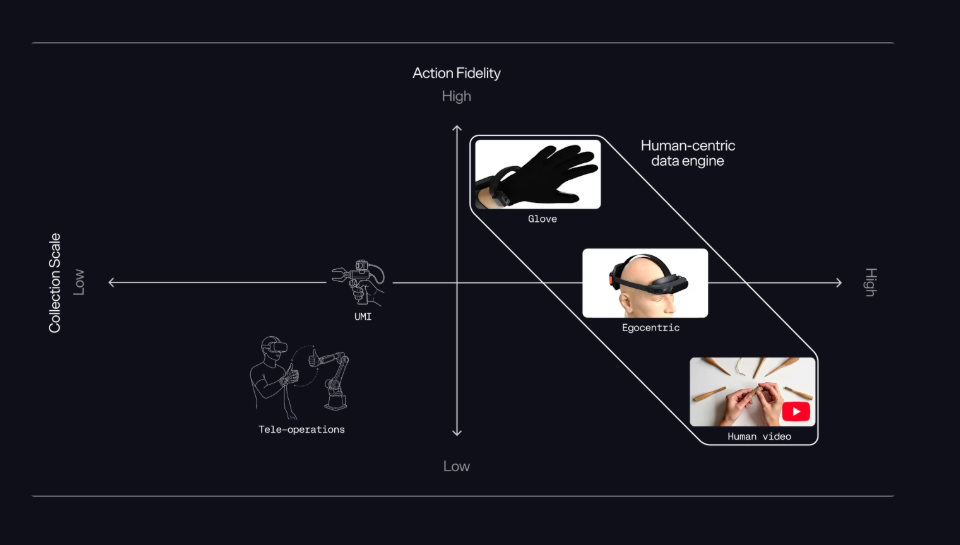

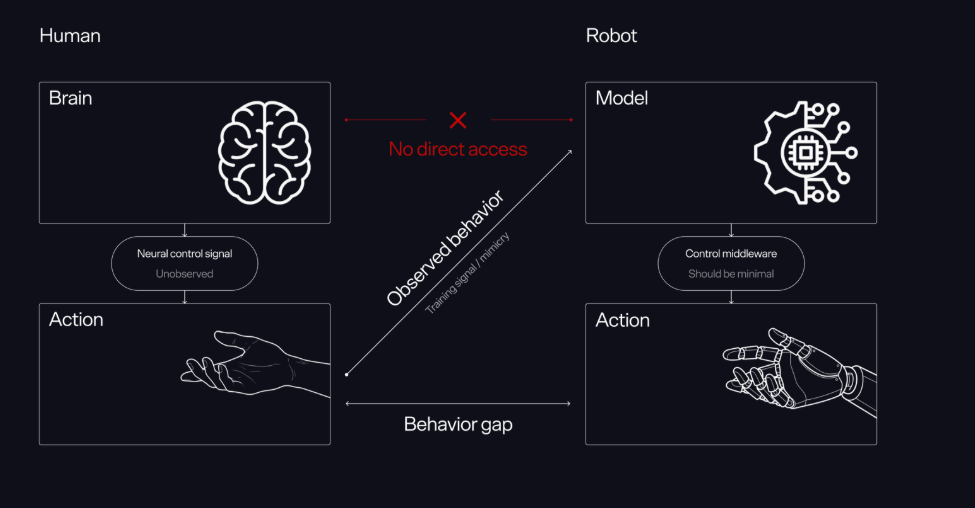

在这之中,Genesis 在数据路线上坚持以人类为中心的数据,这则是基于团队对于机器人最大问题在高质量灵巧操作数据极度稀缺的判断。

在许多遥操作、低自由度操作数据不能满足其需求的情况下,团队直接重新设计了一套人类到机器人的数据链路。核心包括:

- 仿生灵巧手 Genesis Hand 1.0,与人手 1:1 尺寸,20 个主动、反向驱动自由度,软材料覆盖掌心与手指。尽可能消除身体差异,减少映射本身带来的信息损失。

- 数据采集手套,团队做了一套 EMF + tactile sensing 的数据手套。记录手部运动轨迹的同时还记录触觉、力反馈和接触状态,Demo 中许多操作其实都依赖这类关键数据。

视觉只能看到结果,很多情况下真正决定动作是否成功的,是力觉反馈,这也是现在许多团队开始重新重视触觉的关键原因。

在数据硬件、伙伴协作的基础上,Genesis 透露团队已经采集了超 20 万小时的跨模态数据。涵盖用手套工作的数据、人类第一视角、互联网视频等数据类型。

仿真成了基模迭代的加速器

即使有了规模化数据采集方案,真实世界的机器人训练仍然太慢了,所以 Genesis 的另一个关键布局是高保真仿真环境。

如果说数据引擎解决了训练时「喂什么」的问题,那么仿真瞄准的就是训练成果到底怎么样的问题。

在 LLM 领域,评估一个新 checkpoint 的成本极低,跑 benchmark,几分钟出结果,迭代频率可以很高。但机器人基础模型不是这样的。

真实世界的机器人评估往往每次任务需要几分钟,每个 checkpoint 需要数十次甚至数百次重复,每个变量(光照、物体位置、指令措辞)都要单独测。算下来,评估一个 checkpoint 的人机工时可能需要数天。

这个差距不只是效率问题,更直接影响着模型迭代次数。

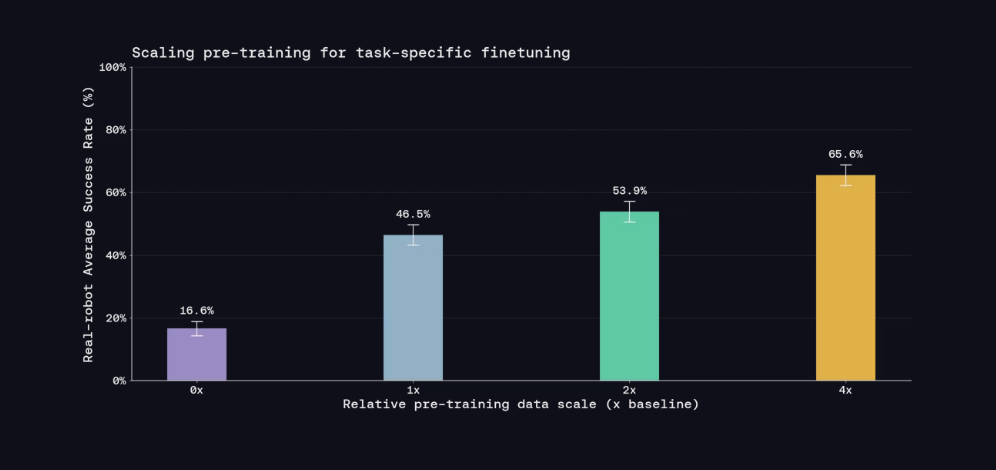

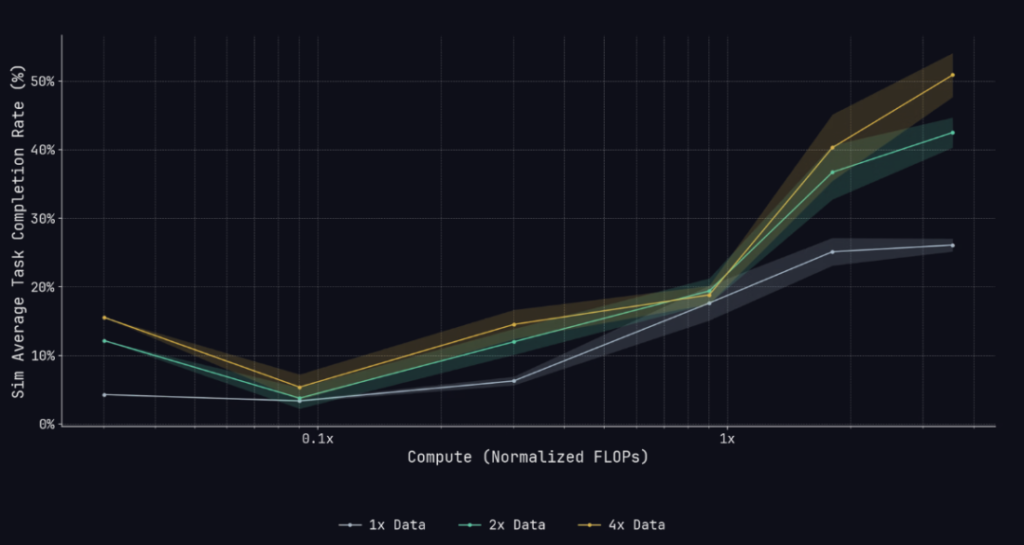

所以 Genesis 试图用仿真来处理整个问题,在扩展律图表中,它对应了 2,700 个人机工时的评估量,如果放在真实世界,这几乎不可能完成。

而在仿真里,这些实验覆盖了数百种光照、背景、物体属性、场景布局和指令表述的变体组合,可以系统性地探测模型的泛化边界。

控制系统同样重要

除了模型、数据等方面,Genesis 这次带来的另一个重点,其实是在控制层。

一般情况下,当模型输出动作指令时,它要经过控制中间件、PID 控制器、电机 FOC 驱动这几层,每层都会引入延迟和误差。

传统方案是用遥操作数据训练,这样的数据天然包含了机器人自身的延迟特性,模型学会了「预期延迟」。但当 Genesis 想用人类数据训练时,这个假设就失效了,训练数据没有延迟,但机器人执行有延迟,形成训练部署分布偏移。

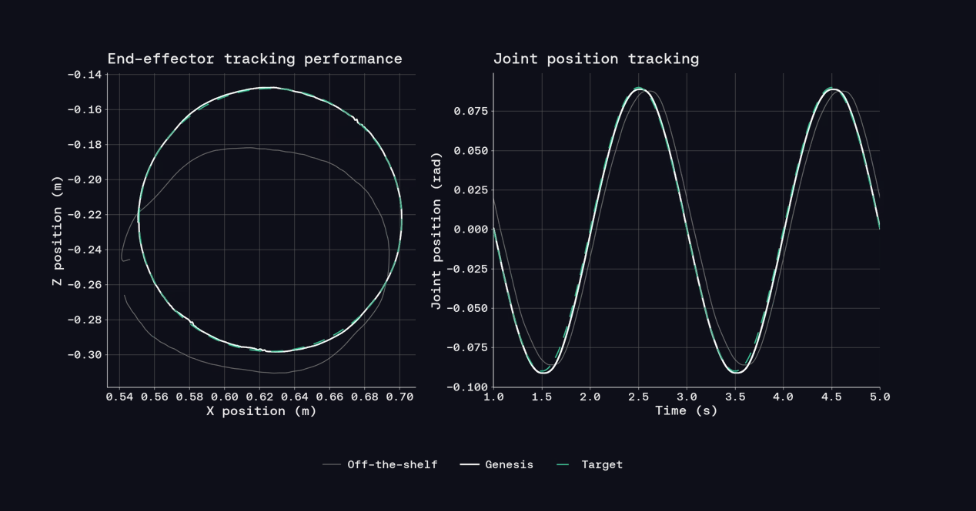

针对这种情况,团队直接重写了机械臂控制中间件,包括 PREEMPT_RT、EtherCAT、实时调度、500Hz 控制频率、自定义 impedance controller。

结果是轨迹误差从之前的 20mm 降低到了 2mm,延迟从 80ms 降低到 9ms,极限可做到 3ms。

这些操作让机器人终于开始接近「实时接触控制」。在此之前,很多灵巧操作不是会不会的问题,而是来不来得及的问题。

尤其是在动态抓取、双手协同、快速接触调整、柔顺控制等方面,一旦延迟太高,整个动作都会变形。

这也让训练数据的可用范围不局限于「带机器人动力学噪声」的遥操作数据,而是可以直接从干净的人类运动中学习。

写在最后

这次 Genesis 发布的 GENE-26.5,其实不光 Demo 足够惊艳,更重要的是它再次验证了一件事,机器人行业正在从「单点能力竞争」,进入「系统能力竞争」。

随着近一年来机器人开始逐步进入复杂的真实场景,大家越来越发现,机器人并不是一个单模块问题。软件、硬件、数据等任何一个环节出现问题,最终都可能会导致任务失败。

这也是为什么,现在越来越多头部机器人公司,路线开始逐渐趋同。

就像 Figure 创始人曾经强调的那样:「如果你从事机器人行业,却不全力去解决硬件问题的话,那就无法成功。」这也在一定程度上反映出了 Figure 的全栈思维体系。

在这条赛道上,大家正在不约而同地搭建数据引擎、硬件系统、低延迟控制等能力体系。

因为行业已经意识到,机器人真正的瓶颈,并不在某一个能力的上限,而在整个系统能否形成持续迭代的闭环。GENE-26.5 最值得关注的,恰恰是这种全栈化趋势。