在机器人落地干活这条路上,世界模型(WM)被很多人认为是上限更高的技术路径,不过在行业逐渐对其范式形成共识之际。星海图团队发布的世界模型研究成果 Fast-WAM,让机器人的反应速度大幅提升的同时,也提出了一个非常直接的问题:

「WAM(世界动作模型)真的需要先想象再行动吗,它的能力究竟来自于哪?」

最近一两年来,从 WM 到 WAM,行业逐渐形成了一条相对清晰的路径,即感知、内部建模、想象未来、规划动作到执行的流程。

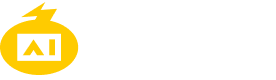

根据这些步骤,不少主流的 WAM 都遵循「先想象,再执行」的统一范式,模型在推理阶段,会根据当前观测 + 动作候选,生成未来的视频序列,在这些想象出来的未来中评估最优动作。

这套方法的直觉很好理解,看起来也非常合乎逻辑,但如果每动一下,都要生成一段视频来评估哪个动作最优,再加上动辄数百毫秒延迟的话,那在需要实时响应的现实场景中,它的可落地性就会大打折扣。

针对这些问题,Fast-WAM 给出了不一样的答案,机器人在推理阶段可以跳过未来预测,不必想好了再动手。并且世界模型的威力根植于视频建模能力,而非视频生成过程。

不过,如果推理阶段不再想象未来,那世界模型到底还剩下什么,Fast-WAM 又如何保证性能不出现下降?

把世界模型拆开看

在传统 WAM 中,视频预测既是训练目标,也是推理手段,这两件事是绑在一起的。

而 Fast-WAM 的出现,选择把训练与推理这两个纠缠不清的环节拆开。

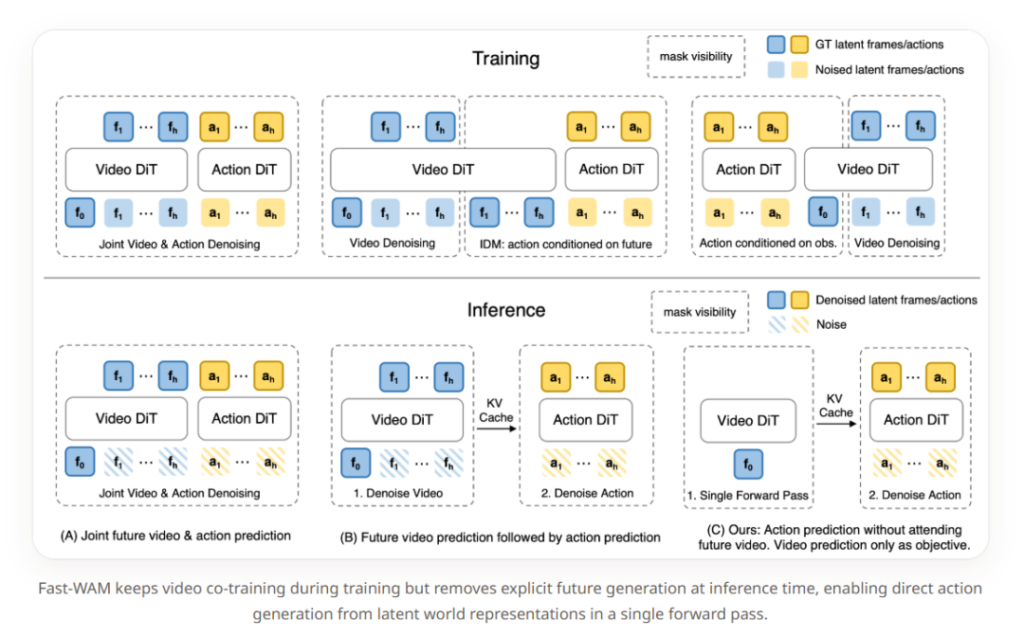

- 训练阶段:Fast-WAM 没有抛弃世界模型最核心对世界动态的建模。在训练过程中,它依然输入当前观测 + 动作。预测未来的视觉变化,但这里的重点不在生成视频本身,主要是通过视频预测,让模型学会世界的因果结构和物理规律。

- 推理阶段: 在执行任务时,Fast-WAM 砍掉冗余的预测分支,不再进行迭代去噪,仅通过一次前向传播直接提取隐含物理规律的「世界表征」。世界模型仍然存在,只是不再以「显式想象未来」的形式出现。

在这个过程中,研究团队做了一些对照实验,实验结果显示:

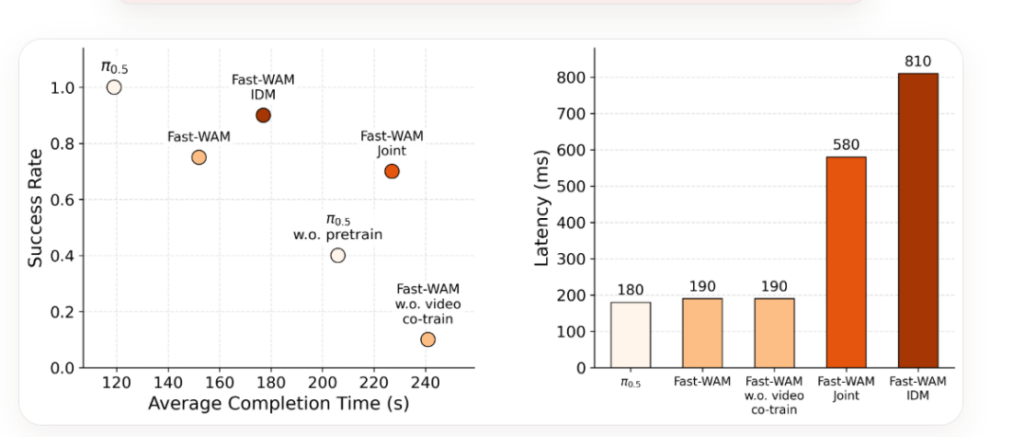

- 保留训练中的视频建模,但删除推理阶段的视频生成,性能基本不变。

- 删除视频建模能力,性能明显下降。

这也就回答了开头的问题,WAM 的能力来自「学会世界」,并不是「每次都去生成未来」。

4 倍提速,机器人反应更快

如果说前面的变化还停留在范式层面,那么 Fast-WAM 最直接的结果,就是推理速度的显著提升。

在研究团队进行的多个实验任务中,Fast-WAM 将推理延迟降低至约 190 毫秒,相比一些需要进行未来想象的方案(800 毫秒量级),实现了约 4 倍的速度提升。

这里的提升主要是来自计算路径的变化,在传统 WAM 中,推理延迟主要消耗在多步 rollout(展开未来轨迹)和视频生成上,这两者叠加起来,让机器人的每一步动作决策,都需要一轮重计算,而且随着 rollout 步数增加,延迟线性甚至更高增长。

Fast-WAM 的提速,本质上来自三个方面:

- 去掉多步 rollout,从多步未来展开,变成单步前向预测,砍掉一个时间维度。

- 不再生成视频序列:从高成本的像素空间生成变成低成本的 latent 空间前向,计算复杂度明显下降。

- 决策变为一次前向传播:最终动作选择变成一次前向计算,而不是一个搜索过程,这让整个系统更接近策略网络。

在速度和实时控制方面,世界模型路线在此前一直都存在短板,这也是其难以落地实时运行的关键障碍。

很多世界模型方案的问题不在于能不能正确做出决策,问题就出在有没有及时响应的能力,毕竟在时刻都在变化现实场景中,快速应变在很大程度上影响着机器人执行任务时的成功率。

所以这 4 倍提速带来的,就是世界模型路线最需要的落地能力。

显式推理在逐渐弱化

最近一年来,关于如何让机器人规模落地的研究越来越多,大家也都不约而同地发现了机器人反应速度过慢的问题,在这个过程中,不同的路线也带来了相应的技术方案:

- 一类是以 Fast-WAM 为代表的世界模型路线,跳过推理阶段的未来预测,通过一次前向传播直接提取隐含物理规律的「世界表征」,从而提升推理速度。

- 另外也有 LaST₀ 这种 VLA 路线,选择不依赖「显式语言推理」,将思考过程转移到连续的隐空间时空表示中,在保留推理能力的同时显著压缩推理路径,让机器人反应更快。

- 以及像 DVA(直接视频动作)模型这样的尝试,让机器人直接从视频中学习世界如何变化,再将这种预测能力转化为动作控制,进一步压缩感知到动作之间的链路。

他们的路线虽然不同,但本质上都在走同一个趋势:显式推理,正在从必要条件,变成可选机制。

相比把问题想清楚,机器人更需要的是足够快的反应,和动态环境中的持续调整能力。在这种前提下,推理不一定要被展开,而是可以被压缩进模型本身。